El maltrato online y la extinción del diálogo

Hace unos días había leído cómo Stack Overflow había perdido el 80% del tráfico y que éste se había volcado a las distintas herramientas de AI que hay disponibles. Herramientas que fueron alimentadas, entre otras fuentes, por Stack Overflow.

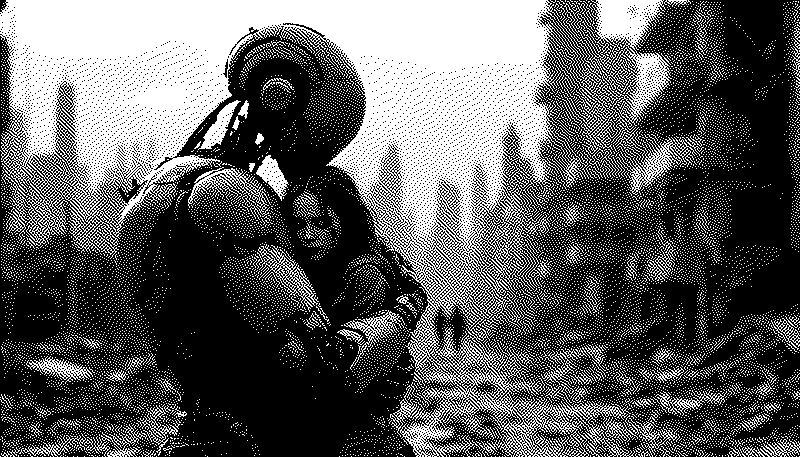

Esto es interesante, una gran masa de humanos abandonó la conversación humana por la robótica ¿Por qué? Pues al comentar esto en redes recibí muchas e interesantes respuestas y casi todas hablaban de lo mismo: toxicidad.

Hasta no hace mucho tiempo la mayoría de los programadores, de distintos niveles, entraba a Stack Overflow o foros similares para realizar consultas. Ya fuere una lista de correo, un foro, todo tipo de comunidad.

Estas comunidades están manejadas por humanos, el diálogo es entre pares, supuestamente, pero lo que siempre prevaleció fue el maltrato de los intolerantes.

Usualmente hablamos de gente que no sabe mucho de algo y, para mostrarse superior, encuentra como mecanismo de revalidación el ataque al que sabe un poco menos.

El escenario habitual era que alguien preguntaba algo, éste "troll-tonto" lo insultaba y maltrataba por no saber la respuesta a algo "tan obvio" o lo mandaba a "leer la documentación" sin siquiera darle la respuesta a lo que había preguntado.

Es real que el 99% de las preguntas se resuelven con una simple búsqueda en Google, lo que provoca irritación por vagancia, el vago no quiere buscar, quiere que le resuelvan, al que sabe un poco se le inflan los cojones por tanta pregunta repetida y volver a empezar.

Pero si bien ese escenario era típico se empezó a llenar de gente que no es que esté harta de la repregunta tonta, sino de aquellos con gravísimo complejo de inferioridad que encuentran en la violencia una revalidación emocional peneana.

¿Consecuencias? Nadie quiere quedar como un idiota, nadie pregunta, nadie encuentra la respuesta a su pregunta.

Hackeando la imbecilidad

Lo interesante de este escenario de reaccionarios imbéciles es que algunos programadores habían encontrado un fabuloso hack social, y no fue uno sino varios los que me comentaron que lo utilizaban.

Consiste en hacer la preguntonta de aquello que no se sabe con la cuenta principal y, con una cuenta secundaria creada específicamente para esto, dar una primera respuesta totalmente errónea.

Es un pequeño teatro en el cual los troll-tontos encuentran otro objetivo para su agresión permanente: la segunda cuenta que respondió mal.

Entonces se invertía totalmente la agresión, las respuestas violentas eran a la segunda cuenta y en sus respuestas incluían la verdadera respuesta a la pregunta. Una genialidad de hacking social.

Esto no siempre funciona, uno está apostando a que esa caterva de imbéciles sea lo suficientemente reaccionaria y al mismo tiempo inteligente como para que acierten en las respuestas, pero a veces resultaba muy efectiva.

Pero nadie quiere recibir ni leer agresiones innecesarias, nadie lo necesita, nadie tiene por qué tolerarlo, así pues esa pérdida del 80% del tráfico tiene total sentido.

Las AI se alimentaron de esto

No sorprende a nadie que cualquier modelo de LLM utilice las respuestas de Stack Overflow, los manuales de usuario, las documentaciones y todo aquello referido a cualquier lenguaje de programación.

Así podemos tener muy buena generación de código asistidos por AI y todos contentos.

Además de eso, para el novato, es genial porque nadie lo va a insultar por no entender. Esto lo venimos conversando desde un principio, para un LLM ninguna pregunta es estúpida, nos dará exactamente eso que pedimos, no nos dirá "vago, Googleá, yo no estoy para resolverte todo" ni nada parecido.

Lo hace sin cansarse y sin quejarse (salvo que se le agoten los tokens 😁)

Podemos creer que esto es el fin del problema del trolleo online, pero no, es el comienzo de otros problemas.

Primero que nada los modelos de LLM necesitan de toda esa interacción humana para ser entrenados, si el dataset que se usa queda muerto en 2025 y a futuro no se le sirve nada nuevo, no habrá mejoras.

Si el diálogo entre humanos se detiene ¿Con qué nuevo dataset se servirán los que entrenan AI?

Imaginen este escenario: se crea un nuevo lenguaje con una forma particular de crear algoritmos, si no hay acceso a ningún foro, ninguna documentación detallada llena de ejemplos, un LLM utilizará los algoritmos de otros lenguajes para rellenar el vacío, todas esas cosas nuevas que otorgaría ese lenguaje se perderían por falta de conversación, diálogo y descubrimiento colectivo.

Si los humanos mismos matan su propia interacción social y sólo nos queda el buen trato de la máquina ¿Qué nuevas experiencias vamos a transmitir? ¿Qué cosas nuevas vamos a aprender o generar? Sería un tiro en el pie social.

Obviamente para que el desastre se note faltan muchos años, pero, como todo fan de la ciencia ficción, sabemos que los humanos tienen tendencias a encerrarse en soluciones fáciles tecnológicas y olvidarse de la interacción humana, lo vemos a diario, ni siquiera es ficción, hoy por hoy es realidad.

Ese 80% perdido es mucho más que tráfico online, es gente que ya no se habla entre pares, piensen en eso.